Selon le Reuters Institute et l’Université d’Oxford, la confiance envers l’IA générative reste limitée et se concentre sur quelques outils dominants, comme ChatGPT et Gemini.

Publié en octobre 2025, le Generative AI and News Report, du Reuters Institute et de l’Université d’Oxford, analyse la perception et la confiance du public envers les outils d’IA générative. L’étude repose sur une enquête menée auprès de plus de 12 000 personnes dans six pays (France, Royaume-Uni, Danemark, États-Unis, Japon et Argentine).

Elle s’intéresse à la notoriété, à l’usage et à la crédibilité accordée à différents systèmes d’IA, tout en observant comment ces attitudes varient selon les contextes culturels et médiatiques. L’objectif est de mieux comprendre comment ces technologies, de plus en plus présentes dans la production et la consommation d’information, sont perçues par les citoyens et citoyennes. Tour d’horizon !

La confiance envers les outils d’IA générative se concentre sur quelques acteurs dominants

Toutes les intelligences artificielles génératives ne suscitent pas le même niveau de confiance. D’après le Generative AI and News Report 2025, une poignée de produits captent l’essentiel du crédit accordé par le public, tandis que la majorité reste perçue avec prudence.

Confiance rime avec familiarité ?

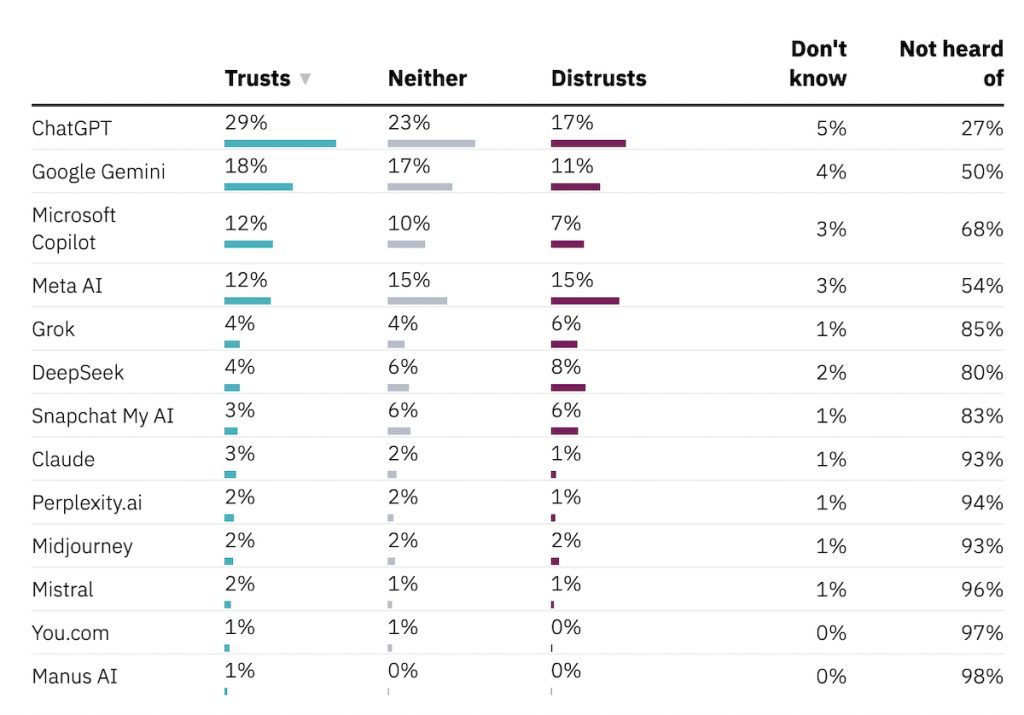

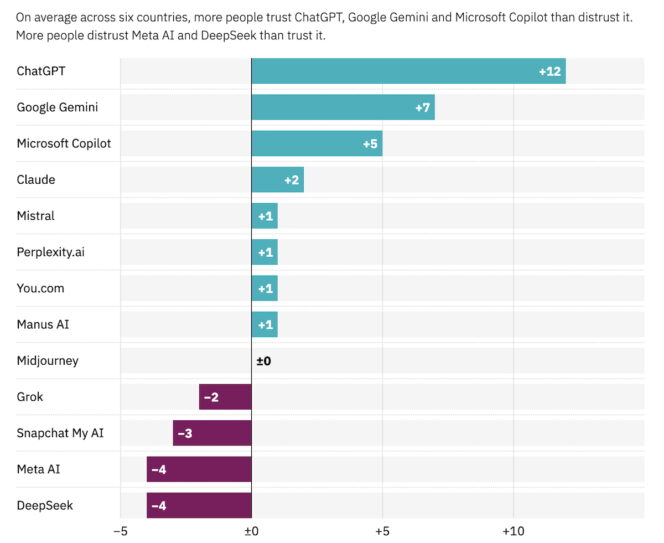

ChatGPT demeure l’outil le plus cité et celui qui inspire le plus confiance. En moyenne, près d’un tiers des répondants dans les six pays étudiés affirme lui faire confiance, un score nettement supérieur à celui des autres systèmes. Derrière, Gemini de Google obtient environ un cinquième d’opinions favorables, suivi de Copilot et de Meta AI, tous deux autour de 10 à 12 %. Les autres IA, comme Claude, Perplexity, Grok ou DeepSeek, restent bien en dessous de ces niveaux, souvent faute d’être suffisamment visibles pour le grand public (voir image du une).

Le rapport précise que ces différences reflètent d’abord la familiarité des utilisateurs et utilisatrices avec chaque produit. Les outils intégrés à des services utilisés au quotidien, comme les moteurs de recherche, les messageries ou les suites bureautiques, bénéficient d’une visibilité accrue et donc d’un capital de confiance plus élevé. À l’inverse, les modèles plus récents ou moins diffusés souffrent d’un déficit de notoriété. Une part importante des sondés explique d’ailleurs ne pas connaître certains outils, ce qui limite leur capacité à en évaluer la fiabilité.

Entre adoption et prudence

Cette tendance confirme une observation déjà formulée l’an dernier par le Reuters Institute. La confiance suit la courbe d’adoption. Les utilisateurs et utilisatrices ont tendance à se fier davantage aux produits qu’ils utilisent régulièrement ou qui appartiennent à des entreprises qu’ils identifient et perçoivent comme stables. Cela explique pourquoi ChatGPT et Gemini conservent une nette avance sur leurs concurrents, tandis que Meta AI, DeepSeek ou Grok peinent encore à inspirer la même assurance.

Le Reuters Institute souligne aussi que la confiance reste globalement modérée, y compris pour les outils les plus connus. Aucun système ne dépasse un niveau majoritaire de confiance dans les pays étudiés. Le public semble ainsi considérer ces technologies comme puissantes mais encore peu fiables, un jugement qui rappelle que la notoriété seule ne suffit pas à dissiper la prudence qui entoure l’usage de l’IA générative.

Des différences culturelles marquées dans la confiance envers les IA génératives

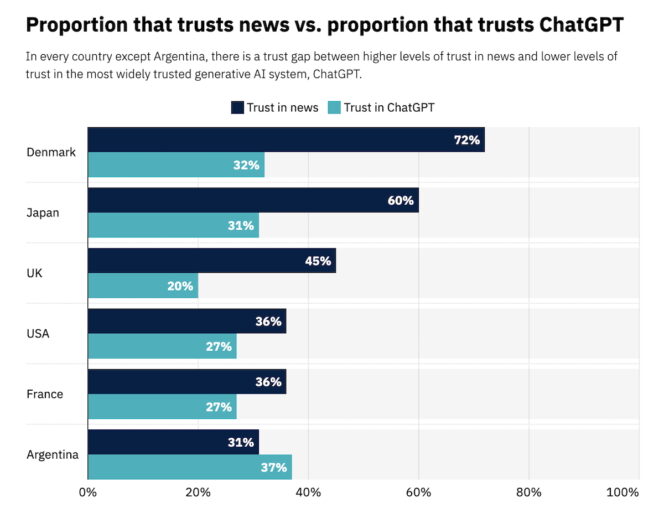

L’étude du Reuters Institute met en évidence des contrastes nets entre les pays dans leur rapport de confiance aux outils d’IA. Si l’usage progresse partout, la perception de fiabilité et de crédibilité reste étroitement liée au contexte culturel et médiatique de chaque société.

Culture du numérique et influence politique

Les répondants du Japon et de l’Argentine apparaissent comme les plus confiants. Dans ces deux pays, une majorité relative estime que les IA génératives peuvent produire des contenus utiles ou fiables, au moins dans certaines situations. Le Reuters Institute y voit l’effet combiné d’une familiarité accrue avec les technologies d’assistance et d’une image plus positive de l’innovation numérique. Ces publics se montrent également moins préoccupés par les risques de désinformation, sans pour autant ignorer les enjeux de transparence.

En Europe, la tendance est plus réservée. En France, au Danemark et au Royaume-Uni, la confiance envers les outils d’IA reste faible et progresse lentement. Les répondants français comptent parmi les plus sceptiques, aussi bien sur la capacité des systèmes à produire des informations fiables que sur leur intégration dans le travail journalistique. Le Reuters Institute relève que ces pays partagent une sensibilité plus marquée aux questions éthiques et aux risques de manipulation, souvent nourrie par des débats publics plus vifs sur l’usage de l’IA.

La confiance progresse plus lentement que l’adoption

Les États-Unis se situent dans une position intermédiaire, avec des niveaux de confiance proches de ceux observés en Europe, mais pour des raisons différentes. Le rapport évoque une méfiance persistante envers les grandes entreprises technologiques, qui pèse sur la perception des IA issues de leurs écosystèmes. Les répondants américains se montrent à la fois familiers des outils et critiques vis-à-vis de leurs implications sociétales.

Ces variations soulignent que la confiance envers l’IA ne dépend pas uniquement du degré d’usage ou de la performance perçue, mais aussi de la culture numérique propre à chaque pays. Dans les contextes où l’IA est perçue comme un prolongement naturel de l’innovation, elle inspire davantage de curiosité que d’inquiétude. Là où la technologie est associée à des enjeux politiques, médiatiques ou économiques, elle demeure entourée d’un halo de prudence. Aucun des six pays étudiés ne fait cependant exception à une tendance générale : la confiance progresse plus lentement que l’adoption.

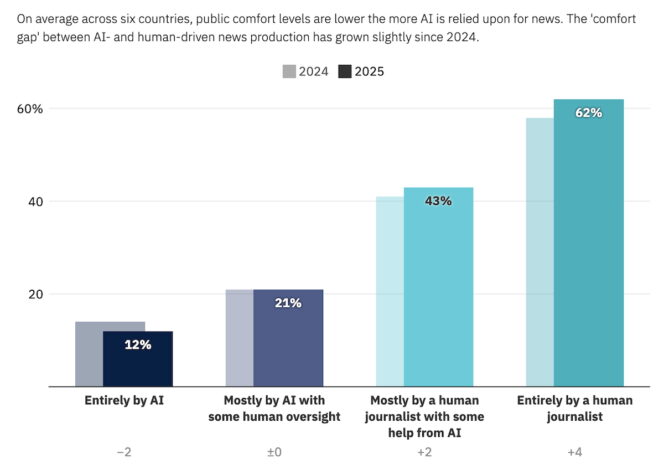

Enfin, le Reuters Institute note que, même si le public reconnaît le potentiel des IA dans la production d’information, une majorité estime qu’elles doivent rester des outils d’assistance plutôt que de création autonome. Les utilisateurs et utilisatrices se disent favorables à leur usage pour des tâches de soutien (résumés, traduction, aide à la recherche), mais beaucoup expriment des réserves à l’idée que des contenus journalistiques soient entièrement générés par IA sans supervision humaine.

Source: BDM